摘要:近日,entity["people","全红婵",0]“带货土鸡蛋”事件被entity["organization","中央广播电视总台",0](央视)揭露,其实并非真实代言,而是利用人工智能技术克隆她的声音进行虚假带货。这一案例不仅折射出人工智能语音克隆技术的飞速发展,更暴露出声音克隆背后的法律、平台监管、消费者保护等一系列乱象。文章首先从事件回顾入手,解析声音克隆技术的技术特征;其次梳理声音克隆对公众信任和消费市场的冲击;再次探讨法律监管与平台责任的缺位;最后提出治理路径与社会应对建议。通过这四个维度,我们不仅可见“听声识人”正在被技术挑战,也应认识到声音权、人格权、消费者权益共同面临的新威胁。在此背景下,构建明确的法律规则、完善技术识别机制、提升公众媒介素养,成为维护数字时代“声音”尊严与安全的新命题。

首先要从事件本身做起:央视披露,多个社交平台账号通过克隆奥运冠军全红婵的声音,为所谓“土鸡蛋”“农家散养鸡蛋”进行带货宣传。citeturn0search0turn0search3turn0seapg国际中国官网rch2

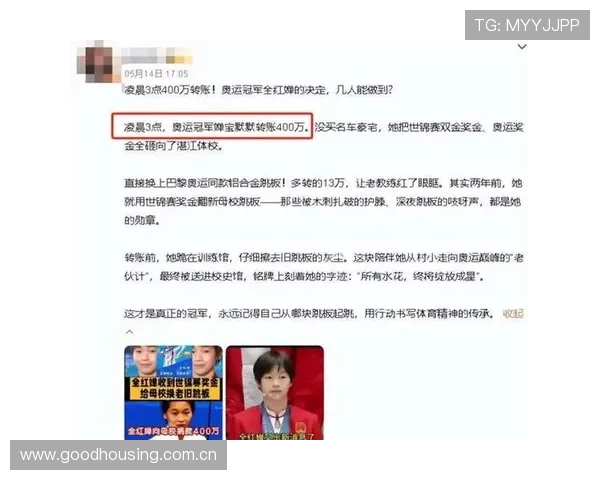

据报道,在一个名为“我是小助理吖”的账号中,已发布17条“全红婵声音”带货土鸡蛋的视频,其中一条点赞量达到1.1万,相关产品链接显示已售出4.7万件。citeturn0search2turn0search3

全红婵本人及其家人则早在四月就声明,并未为该农产品代言或授权。citeturn0search0turn0search7

其次,从技术层面看,语音克隆已经进入“一键式”时代。记者调查发现,基于语音大模型,只需10几秒音频样本便可生成高还原度语音。citeturn0search6turn0search8

更为重要的是,声音克隆的门槛极低、成本极小、操作流程简便:上传短音频样本,系统分析声纹、音调、语速等特征,再输入文字即可朗读生成。citeturn0search8turn0search6

从事件到技术突破,这个案例直指“声音克隆”所具备的假冒便利性及产业化倾向,也揭开了后续乱象发生的前提基础。

声音,作为人类沟通最直观的媒介之一,被名人或公众人物使用,更具有信任背书。当“全红婵的声音”出现在带货视频中,粉丝误以为真,信任基础被迅速动员。citeturn0search2turn0search4

然而,这个信任被技术滥用后变成了骗取流量、诱导下单的工具。大量消费者因为“听到熟悉声音”而下单,不少人因此买到了假冒、劣质或根本无货的产品。citeturn0search8turn0search3

这种破裂不仅是个体消费层面的信任受损,更对公众对数字空间中“声音即真实”的预设构成挑战:我们难以再凭声音识别真实性,也因此对声音所传递的信息产生怀疑。

更严重的是,声音克隆带动了灰色产业链:虚假带货只是表层,后台可能涵盖账号制造、语音合成、名人声纹采集、产品链接推送、打赏诱导等多个环节。citeturn0search3turn0search0

因此,声音克隆不仅侵害了名人的权益,更侵蚀了消费者信任机制、破坏了数字经济生态中“声音背书”的价值。这种信任破裂会长期累积,对平台、对社会都是隐患。

面对声音克隆带来的乱象,法律层面已有响应:我国《entity["legislation", "中华人民共和国民法典", 0]》第1023条将“自然人声音”保护参照肖像权适用。citeturn0search3turn0search5

法律专家指出,利用人工智能仿冒他人身份带货,不仅侵害被仿冒者的声音权、肖像权,同时也侵犯消费者的知情权,若骗取财物数额较大,还可能构成诈骗罪。citeturn0search5turn0search9

然而,在实际操作中,维权存在多重难题:声音样本易复制、自助证明责任重、侵权路径复杂、责任主体不明确,使得被侵害者维权成本高、周期长。citeturn0search4turn0search0

与此同时,平台治理与技术监测尚显不足。虽有规定《entity["legislation", "生成式人工智能服务管理暂行办法", 0]》要求AI服务不得侵害肖像权、声音权等,但平台在识别、拦截、标识、溯源等方面仍缺乏统一标准与强制机制。citeturn0search9turn0search5

总合而言,法律迈出了步伐,但监管執行、技术支撑、平台责任三者之间仍有脱节,声音克隆乱象仍然有可乘之机。

首先,在技术治理方面,应从源头限制AI声音克隆的滥用。一方面对开源语音模型的使用设限,另一方面平台应构建声纹识别、AI生成内容识别、电子水印标识等技术体系。citeturn0search8turn0search1

其次,平台责任不可忽视。社交平台、直播平台需承担更高审核责任,建立侵权举报机制、被冒名识别机制、快速下架机制,同时对违反规则账号进行严厉惩处。citeturn0search7turn0search2

再次,法律机制需进一步完善。包括明确声音权利主体、降低维权门槛、加大违法成本、完善刑事追责路径,并推动全面落实《人工智能生成合成内容标识办法》等配套制度。citeturn0search5turn0search9

最后,公众也需提升媒介素养,强化“怀疑第一条”的意识:在网络带货、直播中,遇到似曾相识的名人声音应冷静甄别,不轻信、不盲从,做到“先查、再信”。

在全社会形成“声音不简单是真”的共识,才能从根本上削弱声音克隆的流量基础与信任基础。

总结:

通过对全红婵声音被AI克隆带货事件的回顾与分析,我们看到了声音克隆技术从突破到滥用的全过程,也认识到这种侵权形式对信任机制、消费市场、法律监管三个层面的深刻冲击。事件既是一面镜子,反映了数字时代“声音”可能被技术架空的问题;也是一个警钟,提示我们必须重视声音权、人格权与公共信任之间的紧密关系。

在未来治理中,技术、平台、法律、公众四方需协同发力,才能筑起一道有效屏障:技术端预防滥用、平台端强化治理、法律端提高惩戒、公众端提升警觉。唯有如此,才能真正让“声音”的尊严得以守护,让数字时代的信任机制不因克隆技术而瓦解。